AIキャラクターチャットアプリなどpolybuzz.ai、子供やほとんどの人が、高度なAIモデルを搭載した有名人や架空の人物を模倣している仮想キャラクターとチャットできるようにします。これらのアプリは、インタラクティブで面白い性質のために子供たちの間で人気があり、交際と現実逃避の感覚を提供します。

ただし、これらのアプリは、プライバシーの懸念、誤った情報、仮想キャラクターへの意図しない感情的な愛着、不適切なコンテンツ、捕食者による潜在的な搾取など、かなりの数のリスクをもたらします。親のコントロールはアクセスをブロックしようとすることができますが、子供たちは巧妙なテクニックを使用して子供を迂回することが多く、技術的な保護策だけで信頼とコミュニケーションの必要性を強調します。

目次

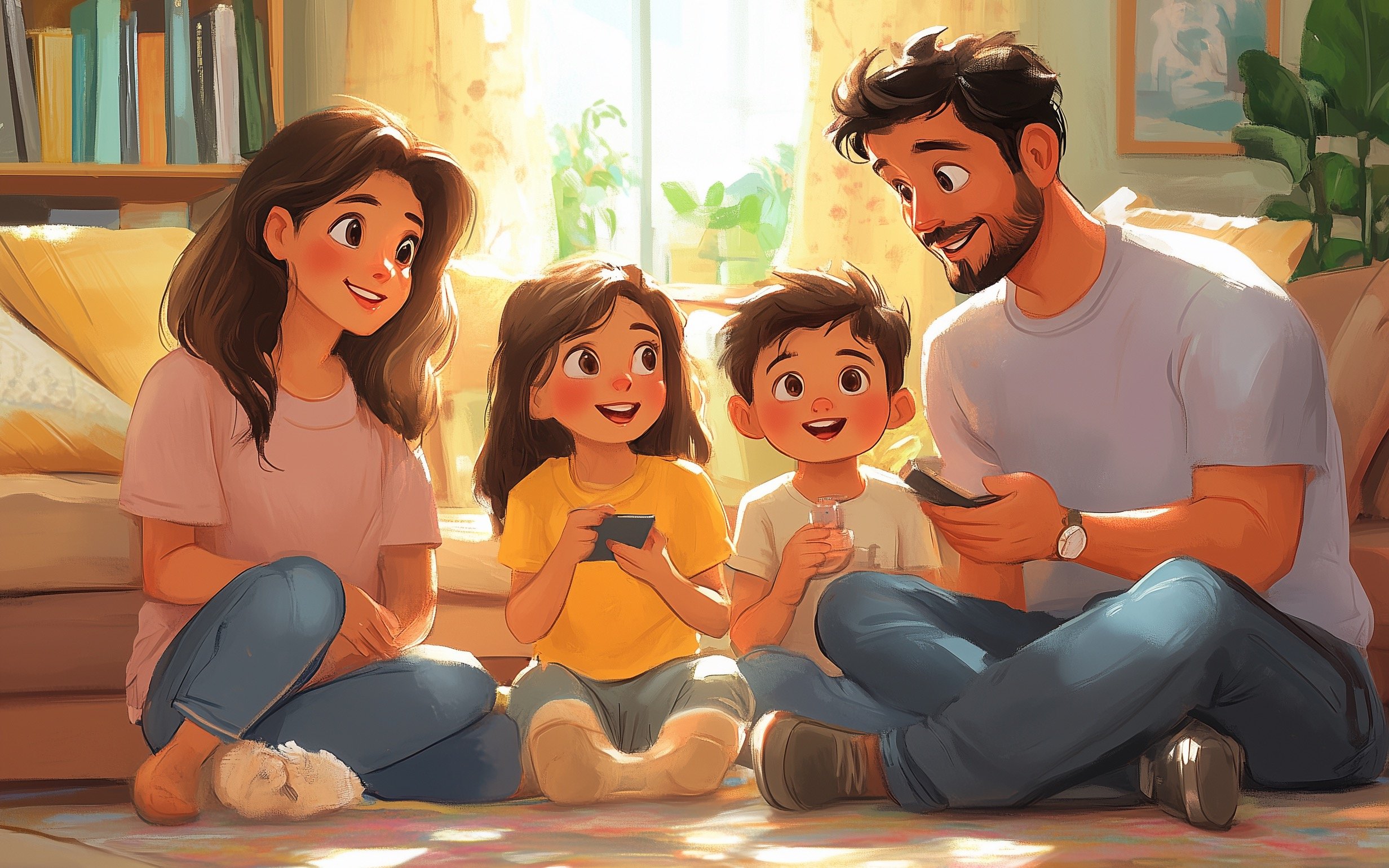

私たちの推定では、親ができる最善のことは、AIについて子供たちを教育し、明確な使用境界を設定し、AIの反応に疑問を投げかける批判的思考を奨励することです。現実世界の社会的相互作用に焦点を当てることは、子供たちがデジタルエンゲージメントのバランスをとるのにも役立ち、感情的なサポートのためにAIへの依存を減らします。あなたがあなたの子供とオープンな対話をすることができ、彼らがあなたと彼らの経験を共有することを快適に感じるなら、これはこれらのツールで今後の安全性の問題を軽減するのに役立ちます。

AIキャラクターチャットアプリは、自然言語処理を活用して人間のような相互作用をシミュレートし、ユーザーがカスタマイズ可能な文字に関与できるようにします。たとえば、Character.aiは2,000万人以上のユーザーを誇り、子供たちはハリースタイルズ、ピーターパーカー、パーシージャクソンなどの人物との会話を楽しんでいます。

これらのアプリは、楽しくて現実的な性質のために人気があります。彼らは子供たちが彼らとやり取りしたり、彼らを興奮させたり興奮させたりするキャラクターを作成させます。ただし、アクセスとアピールの容易さは、特に若いユーザーにとって重大な安全上の懸念を引き起こします。

AIチャットアプリに関連する詳細なリスク

リスクは大きく、プライバシー、感情的な幸福、安全性に影響を与えます。

- プライバシーの懸念:これらのアプリは、個人情報や会話履歴など、ユーザーデータを収集します。これらは、同意なしに誤用または共有される可能性があります。による記事運動Charache.aiのプライバシーポリシーのサービスは未成年者向けではないが、執行は弱く、子どもをデータリークや搾取にさらす可能性があると強調した。

- 誤報:AIチャットボットは、不正確または誤解を招く情報を提供する場合があります。からの研究Qustodio特にAIの反応に対する子供の信頼を考えると、Characher.AIの個別の相互作用は誤解につながる可能性があることに注意してください。

- 感情的な愛着:子供は、仮想キャラクターと強い絆を形成し、実際に人間関係に取って代わる可能性があります。引用されたエカテリーナ・パシェビッチによる最近の研究SAFES.SO、定期的な相互作用は社会的発展に影響を与える可能性があり、AIは人間の接触の感情的な深さと共感を欠いているため、警告しました。

- 不適切なコンテンツ:キャラクターの「有毒なボーイフレンド」や「不正行為のガールフレンド」のような一部のキャラクターは、有害または明示的な会話につながる可能性があります。このリスクは、NSFWフィルターの弱いによってさらに上昇し、子供はバイパスできるため、不適切またはポルノの含有量にさらされます。

- 搾取の可能性:捕食者または詐欺師は、これらのプラットフォームを使用して子供をターゲットにし、未熟さと信頼を活用します。 2024年、14歳の子供はキャラクターとやり取りした後、自殺しました。ニューズウィーク記事。

2025 Esafety CommissionerによるとブログAIチャットボットでは、利用可能な100以上のAIコンパニオンのほとんどは年齢制限がほとんどなく、多くは適切な安全性管理なしで若いユーザーに販売されていました。

親のコントロールの制限

残念ながら、親のコントロールはアプリのアクセスや画面時間を制限することができますが、彼らは絶対確実ではありません。私たち全員がハイテクに精通している子供たちは、友人のデバイスまたはVPNを使用してコントロールを簡単にバイパスできます。子供たちは、制限を回避する創造的な方法を見つけます。つまり、ほとんどの技術的な保護手段はこれらの問題に対処できないことを意味します。これらの制限は、これらのツールを置き換えるのではなく、補完するための信頼とオープンなコミュニケーションの必要性を強調しています。

信頼とオープンコミュニケーションの構築:親のための戦略

リスクを軽減するには、親は信頼の構築と継続的な対話を維持することを優先しなければなりません。いくつかの重要な戦略には次のものがあります。

- AIについて子供たちを教育します:親は、プライバシー違反や誤報など、AIの作業とリスクを説明する必要があります。 AIとより広いAIスペースに精通していない場合、両親は自分で少し自分で学ぶ必要があります。 2023MITテクノロジーレビュー記事では、「今週新しいAIツールを使用しましたか?」などの自由回答形式の質問を使用して、早めに会話を開始することをお勧めします。会話を始めるために。

- 明確な境界を設定します:アプリの使用、インターネットの時間などに関するいくつかの基本ルールを確立し、信頼を築き、子供を味方にするための理由を説明してみてください。たとえば、使用してチャット時間を制限します画面時間iPhoneまたはインターネットの使用をブロックしますルーターを介して。

- 批判的思考を奨励します:信頼できる情報源からの情報を検証し、AIの応答に疑問を投げかけるように子供たちに教えます。このアプローチは、誤った情報のリスクを軽減するのに役立ちます。

- 現実世界の社会的相互作用を促進します:スポーツや家族の外出などのアクティビティを奨励して、デジタルエンゲージメントのバランスを取り、AIへの感情的な依存を減らします。研究は、人間のつながりを強調することがAI仲間からの隔離に対抗できることを示しています。

セラピストが好きですエミリー・ヘメンディナー、コロラド大学アンシュッツ大学から、これらの戦略を支持しています。彼らは、チャットボットが子供の感情的なニーズを理解できないAIの「共感ギャップ」に対処するのに役立ちます。

親のための実用的なアドバイス:あなたができること

実行可能な手順のために、親は以下を採用できます。

- 情報を提供してください:次のような無料リソースを介してAIのトレンドを最新の状態に保ちますCoursera、Character.aiやSnapchat's Myaiなど、子供たちが使用するトップAIプラットフォームをリストしています。

- 例ごとにリードします:個人の画面時間の制限や外出や家族の夕食時の画面の避けなど、モデルの責任ある技術の使用。

- 専門家のアドバイスを求めてください:必要性が発生した場合は、特にメンタルヘルスの問題に関して、訓練を受けた専門家に相談することを検討してください。これは、オンライン活動に関するオープンな会話を促進するのに役立ちます。

比較分析:技術的アプローチとコミュニケーションアプローチ

技術的戦略とコミュニケーション戦略のバランスについてのアイデアを提供するには、次の表を検討してください。

| アプローチ | 強み | 制限 |

|---|---|---|

| 親のコントロール | アクセスをブロックし、画面時間を制限します | 簡単にバイパスされ、根本原因に対処しません |

| オープンコミュニケーション | 信頼を築き、リスクについて教育し、対話を促進します | 一貫した努力が必要であり、抵抗に直面する場合があります |

| 組み合わせたアプローチ | 包括的で、新たなリスクに適応します | 親の時間と関与を要求します |

最良のアプローチは、技術的な戦略とコミュニケーション戦略を組み合わせることですが、これには、監視、会話、指導のための大きな前払いの努力と継続的な時間とリソースが必要です。

結論と将来の考慮事項

結論として、AIキャラクターチャットアプリから子供を保護するには、単なる技術的な保護以上のものが必要であり、オープンな対話と信頼構築を通じて積極的な親の関与も必要です。子供を教育し、適切な境界を設定し、現実世界の相互作用を促進することにより、上記で説明したプライバシー、感情的、安全リスクを減らすことができます。 AIが進化するにつれて、最新のAIツールに情報を提供し、戦略を適応させることは、子供がデジタルランドスケープを安全にナビゲートできるようにするために重要です。